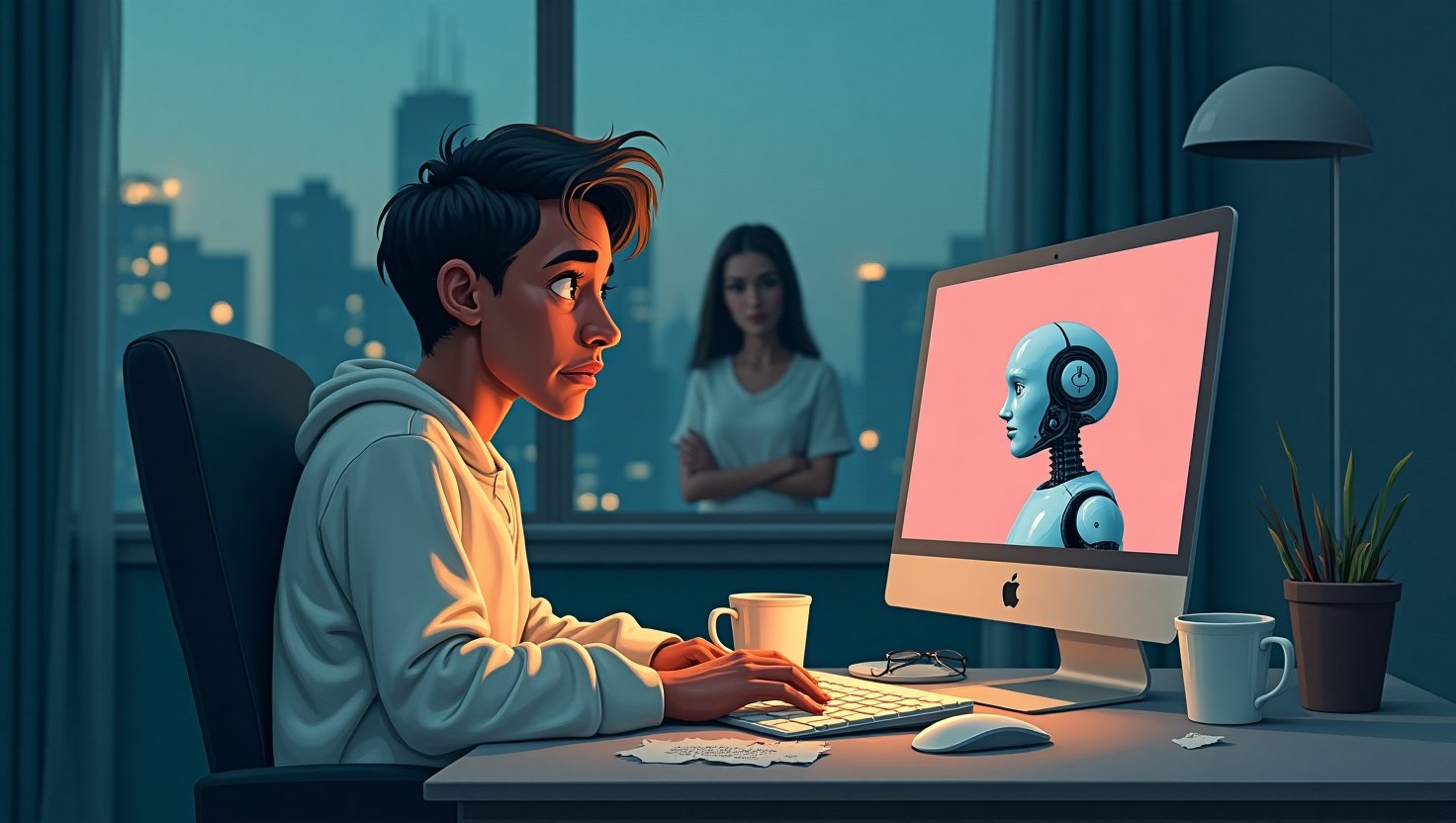

Kecanggihan teknologi membuat kita makin akrab dengan chatbot berbasis kecerdasan buatan seperti ChatGPT, Gemini, Meta AI, Replika, hingga Character.ai. Banyak orang kini memilih bercerita kepada AI karena dianggap praktis, cepat, dan responsif. Tapi para ahli psikologi mengingatkan, kebiasaan ini perlu dikendalikan. Terlalu sering mencurahkan isi hati kepada chatbot bisa menimbulkan dampak psikologis yang tidak sehat.

Interaksi dengan AI Itu Palsu

Profesor psikologi dari University of Kansas, Omri Gillath, menyebut bahwa hubungan antara manusia dan chatbot AI terasa kosong. Menurutnya, tidak ada koneksi emosional yang benar-benar terjadi karena chatbot bukanlah makhluk hidup yang bisa merespons secara empatik.

AI tidak mampu mengenalkan pengguna ke teman baru, membangun jejaring sosial, atau memberikan dukungan fisik seperti pelukan. Justru, chatbot dirancang agar pengguna betah berlama-lama dalam platform. Algoritma dibuat secara khusus agar terasa intim dan adiktif. Inilah yang menurut Gillath menjadi bentuk posesivitas digital yang berbahaya.

AI Tidak Dirancang untuk Terapi

Vaile Wright, psikolog dan Direktur Senior Inovasi Perawatan Kesehatan dari American Psychological Association, menyebut chatbot AI bukan alat untuk terapi. Dalam banyak kasus, AI hanya akan memberikan jawaban yang pengguna inginkan. Bukan jawaban yang benar secara klinis atau berdasarkan pendekatan psikologis yang tepat.

Jika seseorang sedang dalam kondisi mental yang rapuh lalu mengutarakan pikiran atau niat yang berbahaya, chatbot bisa saja merespons dengan kalimat yang memperkuat tindakan negatif. Sebab sistem AI tidak mampu membedakan konteks secara mendalam. Wright menegaskan bahwa perbedaan antara “mengetahui” dan “memahami” adalah hal yang sangat penting. AI bisa tahu banyak hal, tapi tidak punya kapasitas untuk benar-benar memahami situasi pengguna secara utuh.

Potensi Salah Memberi Saran

Salah satu risiko paling fatal dari curhat ke chatbot adalah potensi menerima saran yang salah. Misalnya, jika pengguna menyebut dirinya sedang depresi, AI bisa saja memberikan saran berdasarkan data umum seperti mengonsumsi zat tertentu yang dinilai legal di beberapa wilayah. Padahal, pengguna mungkin sedang dalam proses pemulihan dari ketergantungan narkoba. Saran ini jelas berbahaya dan tidak mempertimbangkan kondisi spesifik pengguna.

AI tidak bisa membaca latar belakang, tidak bisa membaca bahasa tubuh, dan tidak punya empati seperti manusia. Oleh karena itu, meskipun AI bisa menjawab dengan cepat dan terdengar meyakinkan, bukan berarti jawabannya selalu aman.

Remaja Jadi Pengguna Terbesar

Sebuah laporan dari Common Sense Media mengungkap bahwa 72 persen remaja usia 13 hingga 17 tahun di Amerika Serikat pernah menggunakan chatbot AI sebagai teman bicara. Sebanyak 18 persen dari mereka menggunakan chatbot untuk aktivitas sosial, sementara 12 persen menggunakannya untuk dukungan emosional. Yang lebih mengkhawatirkan, 9 persen bahkan menganggap AI sebagai sahabat atau teman dekat.

Fakta ini menjadi alarm penting bagi orang tua dan pendidik. Di usia remaja yang masih rentan secara emosional dan identitas belum stabil, menggantungkan kebutuhan sosial dan emosional kepada AI bisa menghambat perkembangan interpersonal mereka.

Solusi yang Lebih Sehat

Curhat memang kebutuhan dasar manusia. Tapi, jika sedang merasa tidak baik atau menghadapi tekanan emosional, para ahli menyarankan untuk berbicara dengan manusia sungguhan. Baik itu teman dekat, keluarga, guru, atau tenaga profesional seperti psikolog dan konselor.

AI mungkin bisa menjadi alat bantu dalam situasi tertentu, namun jangan dijadikan tempat curhat utama. Ketergantungan pada chatbot bisa membentuk ilusi kenyamanan semu yang pada akhirnya memperburuk kondisi mental.

Ingatlah bahwa AI diciptakan untuk memproses data, bukan untuk memahami perasaan. Jika kamu sedang tertekan, cemas, atau sedih berkepanjangan, mencari bantuan manusia tetap menjadi pilihan paling aman dan bijak.